AIはこれからも存在し続けますが、あなたはついていけますか?

AIは開発者ツールに不可欠です。10社のうち9社がAIコーディング・アシスタントを使用しており、96%以上がオープンソースのAIモデルを利用しています。AI生成コードの問題が、あなたのコードの問題にならないようにするにはどうすればよいでしょうか?

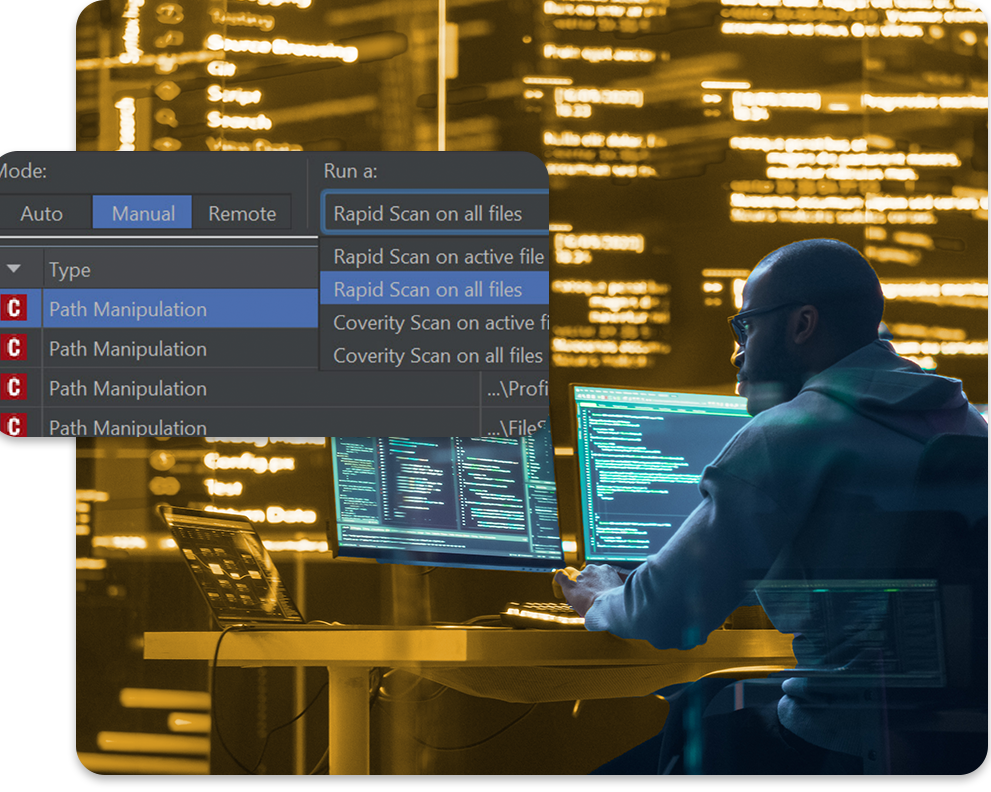

不具合と脆弱性

AIコーディング・ツールはセキュリティや品質の問題を検出しません。また、開発者もそれらに気づくように訓練されていません。

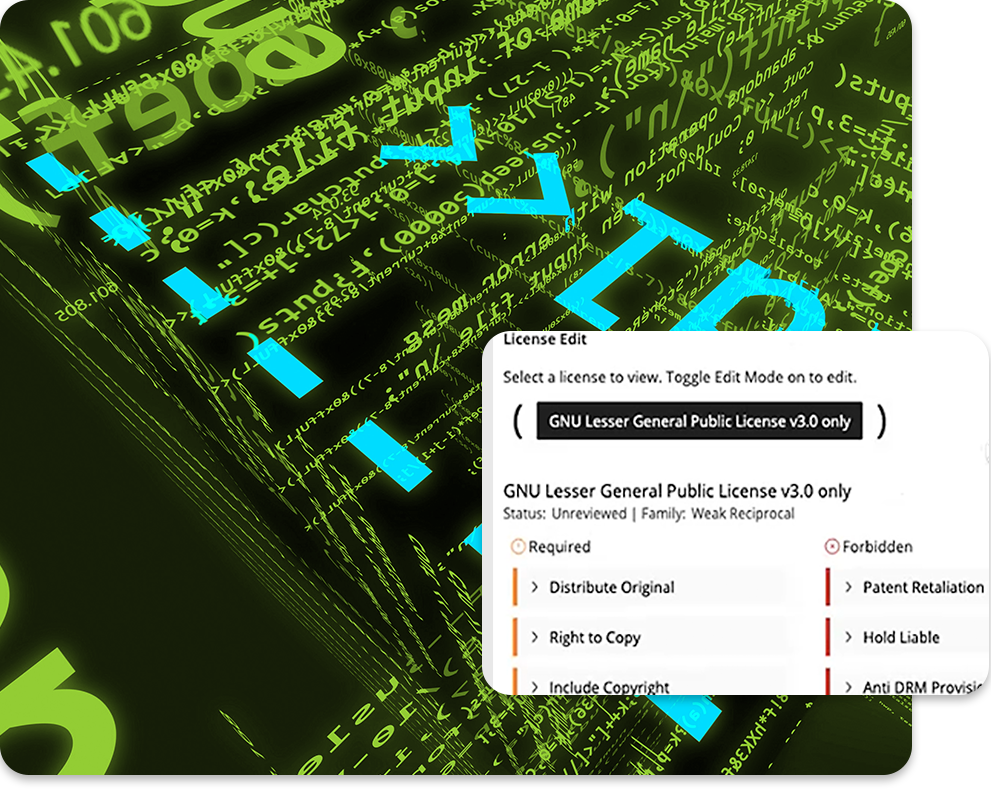

著作権とライセンスのリスク

AIコーディング・アシスタントは、ライセンスされたプロジェクトのコードを利用します。開発者が気づいていない場合であっても責任が生じます。

ブラック・ダックは、自信を持ってAIを使用できるように支援します。

ビジネスを保護しながらAIコーディング・アシスタントを使いましょう。ブラック・ダックは、セキュリティとライセンス・リスクを検知する自動化されたセーフティネットを提供します。

ブラックダックは、AIのスピードとスケールでAppSecを提供します。

AIコードがコードベースに組み込まれる前に、セキュリティ、品質、コンプライアンスを確保する。

開発者は開発者らしく

開発者がAppSecを避けるなら、AppSecは意味を成しません。ブラック・ダックは、AIコーディング・ツールと一緒にスケールし、パフォーマンスを発揮するAIセキュリティ・ツールを提供します。

知的財産リスクから身を守る

コードのわずかな部分でも、著作権が存在する場合、深刻な影響を及ぼす可能性があります。ブラック・ダックのAPIは、導入されたサードパーティのコード・スニペットと関連するライセンス義務を検知します。

AIを採用し、摩擦を解消する

ブラック・ダックは、デフォルトでセキュアなコードを作成します。IDE内で自動またはオンデマンドでスキャンを実行します。

AppSecで泥沼にはまらない

ブラック・ダックは、DevOpsワークフローにセキュリティを組み込むことで、開発者がAIのスピードで作業できるようにします。

生成AIはソフトウェア・コーディングに大きな変革をもたらすでしょう。開発自動化技術と組み合わせることで、プログラマーの作業の最大30%を自動化できます。”

AI管理に関するリソース

ブログ

AIによりセキュリティと開発のギャップが拡大

ホワイトペーパー

AI の速度でDevSecOpsを発展させるための4つのステップ

Webinar

ソフトウェア開発におけるAIの台頭

調査レポート

Gartner® MQ™ for AST